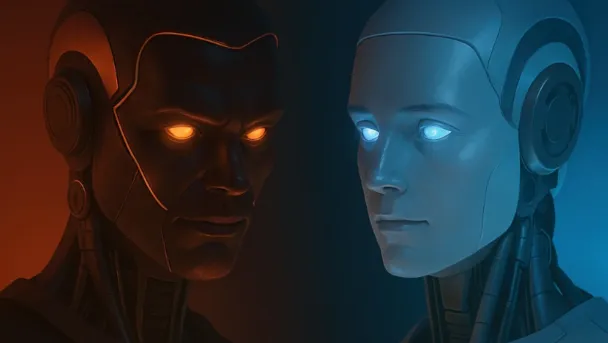

Цифровой сценарист: как ИИ создает иллюзию свободы выбора

Как алгоритмы формируют ложные ориентиры

Человек быстро привыкает к технологиям, воспринимает их как должное и начинает им чрезмерно доверять. При этом когнитивные способности людей, постоянно использующих вспомогательную технологию, ухудшаются. Наглядный пример — использование GPS. Навигаторы часто обманывают водителей, а те слепо следуют указаниям программы, не обращая внимания на реальную обстановку на дороге. Если водитель всегда слушается систему навигации, он теряет способность ориентироваться на местности и быстро принимать правильные решения в опасных ситуациях за рулем. Так привычка полагаться на технологии снижает критичность восприятия.

Аналогичный эффект оказывают алгоритмы ИИ, управляющие соцсетями. Согласно исследованию Pew Research Center, они направляют огромное количество людей к контенту, который вовлекает их просто потому, что вызывает злость и разжигает эмоции. Так людей подталкивают к мыслям и решениям, которые они могли бы не совершать, наблюдая другой контекст.

Вижу то, что нравится

Алгоритмы формируют информационный пузырь вокруг каждого из нас. Иногда контраст между реальностями, в которых живут члены одной семьи, поражает. Многие не видят, насколько досконально и незаметно алгоритмы изучают их поведение, эмоции и предпочтения. Человек полагает, что самостоятельно выбирает контент в Instagram (принадлежит Meta, которая признана в России экстремистской и запрещена), хотя на самом деле его предлагает рекомендация, построенная ИИ после детального изучения вкусов. И когда алгоритм подсовывает пользователям то, что выгодно кому-то, но прячет альтернативную информацию, которая могла бы пробудить осознанность, человек видит мир через фильтр своих предыдущих предпочтений. А это ограничивает возможность свободного выбора и выхода за рамки привычного. Так алгоритмы контролируют нас, препятствуют росту осознанности и расширению мировоззрения. Причем это окружает нас повсюду:

- рекомендательная система Netflix (и многих других онлайн-кинотеатров) работает на материалах изучения истории просмотров, оценок и исследованиях выборов других пользователей с похожими вкусами. При таком подходе вряд ли в рекомендациях пользователь увидит произведения из других жанров. С одной стороны, это удобно — видишь только то, что нравится, но с другой — это гарантированное попадание в информационный пузырь;

- Spotify ограничивает музыкальный вкус слушателей, формируя рекомендации на основе его ранее сделанных предпочтений;

- Amazon и в меньшей степени Ozon и Wildberries (их алгоритмы не так сильно продвинуты, как у американского маркетплейса) работают по той же схеме, управляя вниманием и кошельком покупателей (бесконечные пуши и персонализированные рассылки, созданные ИИ).

Кому выгодно влиять на наш выбор

Вспоминается публичный скандал 2014 года, когда компания Cambridge Analytica злоупотребляла личными данными пользователей Facebook (принадлежит Meta, которая признана экстремистской в России и запрещена), чтобы помочь Дональду Трампу выиграть президентскую гонку. Потенциальные избиратели получали персонализированный с помощью ИИ контент, который манипулировал ими и разжигал ненависть к другому кандидату.

Политики и бизнесмены охотно используют алгоритмы. Первые заинтересованы в контроле выбора граждан через манипуляцию информацией. Вторые используют ИИ, чтобы максимизировать прибыль, направляя потребителя к избыточному потреблению товаров и информации, постоянно предлагая то, без чего человек мог бы спокойно обойтись. Одни ведут предвыборные кампании, исходя из портрета избирателя, зная, на какую больную мозоль ему наступить. Другие ненавязчиво предлагают таргетированную рекламу. Они как будто слышат, о чем люди говорят у себя на кухне, и незаметно формируют рекомендации.

Кажется, выбирая того или иного кандидата или совершая покупку, которая до этого целую неделю появлялась на экране нашего телефона, мы делаем этот выбор осознанно. Но на самом деле это ИИ-инструменты помогают государству направлять внимание граждан в нужное русло, а технологическим гигантам — выстраивать многомиллиардный бизнес, ориентируясь на предсказания поведения пользователя, покупателя и зрителя.

Возможные последствия

Самым тяжелым последствием для человека, живущего в манипуляционном информационном пузыре, созданном алгоритмами ИИ, является потеря навыков критического мышления и самостоятельного принятия разумных решений (как в примере с GPS). Так возникает глобальная угроза создания общества, подверженного манипуляциям, где люди не способны делать осознанный независимый выбор.

Это может стать причиной ослабления демократии, усиления поляризации мнений и социальных потрясений. Видимо, людям общества потребления нужна разумная доля аскетизма. Тогда они смогут противостоять чрезмерному комфорту, разрушающему нейронные связи, и распознавать манипуляции, которые отнимают право личного выбора.

Как распознать технологическую манипуляцию

Основной способ борьбы с манипуляциями алгоритмов, созданными ИИ — это умение их распознавать. Рассмотрим на примере маркетплейса. Очередной раз добавляя товар в корзину, задайте себе пару несложных вопросов:

- Я действительно нуждаюсь в этом или решение купить появилось спонтанно после просмотра рекламы и рекомендаций?

- Был ли у меня интерес/желание к этому до того, как алгоритм начал активно предлагать этот продукт?

- Могу ли я легко отказаться от этого сейчас, не испытывая дискомфорта?

- Почему я это хочу: потому что это нужно лично мне или потому что все это имеют?

Спасаем себя сами

Государство должно защищать граждан от манипуляций алгоритмов ИИ, чтобы не подрывать доверие к институтам власти. Но пока что это сложно себе представить, особенно если вспомнить январь этого года и инаугурацию Дональда Трампа, где в зале присутствовали Тим Кук, Илон Маск и Марк Цукерберг. Это наталкивает на вывод о лоббизме технологических компаний, что, в общем-то, уже и не новость. Деньги продолжают очень сильно давить на власть, не давая ей защищать интересы граждан.

И что делать? Следует осознанно отказываться от действий, к которым подталкивает манипуляционная рекомендация маркетплейса, назойливая таргетированная реклама, почтовая рассылка и т.д. Хороший результат дает цифровой детокс. Если отложить гаджеты в сторону хотя бы на один день и практиковать такое раз в месяц, это позволит мозгу отдохнуть от зомбирующей информации, вернуться к реальной жизни в моменте и по-новому посмотреть на все, что происходит вокруг.

Проблему технологической манипуляции нужно открыто обсуждать, чтобы каждый понимал, как работают алгоритмы соцсетей, поисковых систем, маркетплейсов и не соглашался бездумно с их предложениями. В целом такую просветительскую деятельность уже ведут некоторые СМИ, объясняя, как работают ИИ-алгоритмы. Но этого мало. Также важно в будущем ввести в школах уроки медиаграмотности и развития критического мышления, а государствам и НКО — создавать социальную рекламу на эту тему.

Искусственный интеллект не всегда отбирает свободу выбора напрямую, но он ее однозначно сужает, создавая иллюзию самостоятельного принятия решений. Нам как человечеству предстоит переосмыслить, что такое свобода в эпоху доминирования ИИ-алгоритмов, научиться сопротивляться манипуляциям искусственного интеллекта и стать более осознанными в каждом своем выборе.

Мнение редакции может не совпадать с точкой зрения автора