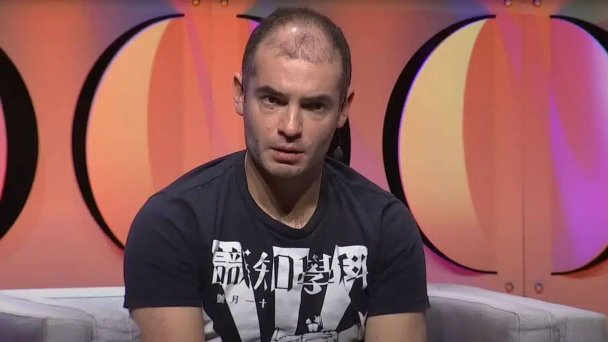

Ушедший из OpenAI Илья Суцкевер раскрыл детали своего нового ИИ-стартапа

Бывший научный руководитель OpenAl (разработчик ChatGPT) Илья Суцкевер, в мае ушедший из компании, объявил о запуске нового собственного стартапа под названием Safe Superintelligence (SSI). «Мы будем заниматься разработкой безопасного суперинтеллекта, это наш единственный фокус, единственная цель и единственный продукт, который мы будем стремиться создать одним точным выстрелом», — написал он в соцсети X (бывшая Twitter, заблокирована в России).

Суцкевер сообщил, что у SSI будут офисы в Пало-Альто (Калифорния) и Тель-Авиве. Сооснователями проекта вместе с ним стали бывший глава отдела ИИ-разработок в Apple Дэниэл Гросс и Дэниэл Леви, который ранее тоже работал в OpenAI.

Суцкевер в беседе с Bloomberg отказался назвать имена финансовых спонсоров SSI или раскрывать сумму, которую проект уже привлек. При этом Гросс подчеркнул: «Привлечение капитала не входит в число проблем, с которыми мы сталкиваемся».

Суцкевер объяснил агентству, что его проект «будет полностью изолирован от внешнего давления, связанного с необходимостью иметь дело с большим и сложным продуктом и необходимостью погрязнуть в конкурентной борьбе».

Он сообщил, что под безопасностью суперинтеллекта подразумевает нечто, подобное ядерной безопасности, что совсем не идентично «доверию и безопасности». И рассказал, что крупные языковые модели, которые доминируют в ИИ, будут играть важную роль в безопасном суперинтеллекте, но необходимо стремиться к чему-то гораздо более мощному. В нынешних системах «вы разговариваете с ИИ, беседуете, и все», но речь идет о гигантском суперцентре обработки данных, который самостоятельно разрабатывает технологии, и «мы хотим внести свой вклад в безопасность всего этого», сказал он. И подчеркнул: «На самом базовом уровне безопасный суперинтеллект должен обладать свойством, позволяющим не причинять масштабный вред человечеству».

Суцкевер родился в 1984 году в Нижнем Новгороде. В 1991-м вместе с семьей эмигрировал в Израиль, откуда переехал в Канаду. В 2015 году Суцкевер стал главным научным сотрудником OpenAI и осознал, что ИИ может развиваться до уровня AGI (artificial general intelligence), который будет превосходить человеческие возможности и может быть опасен, если не «согласован» с человеческими ценностями. В конце 2022 года Суцкевер выразил обеспокоенность тем, что AGI будет относиться к людям так же, как люди в настоящее время относятся к животным, рассказали ранее источники WSJ.

Именно из-за этого, как писала газета, Суцкевер поссорился с главой OpenAI Сэмом Альтманом. В ноябре 2023 года, по данным источников WSJ, Суцкевер инициировал увольнение Альтмана, который перешел в Microsoft. После того как 700 из 770 сотрудников OpenAl пригрозили уйти вслед за Альтманом и возмутились инвесторы, Суцкевер выразил сожаление о случившемся и пообещал «сделать все, что в его силах, чтобы воссоединить компанию». Альтман был восстановлен в должности, но сразу заявил, что Суцкевер не вернется на прежний пост члена совета директоров. В мае 2024-го Суцкевер ушел из компании.

Сейчас на вопрос Bloomberg об отношениях с Альтманом Суцкевер ответил, что «все хорошо», что его бывший начальник знает о новом проекте «в общих чертах». По поводу опыта последних нескольких месяцев он заявил: «Это очень странно. Не знаю, смогу ли я дать лучший ответ, чем этот».