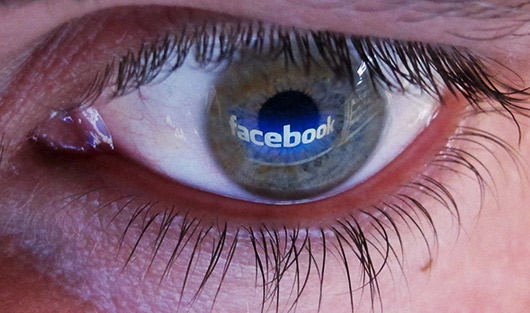

Эксперимент Цукерберга: как Facebook протестировала эмоции 700 000 пользователей

Вряд ли есть в мире научная лаборатория, которая могла бы похвастать большим объемом накопленных данных в области исследований человека, чем Facebook. У социальной сети нет нужды договариваться с участниками экспериментов об использовании их персональной информации или тратить время на бюрократию. Любой пользователь сервиса соглашается с условиями «политики в отношении обработки персональных данных». А специалисты Facebook беспрестанно работают над новыми методами анализа личной информации аудитории, чтобы лучше понять ее поведенческие паттерны.

Впрочем, порой результаты исследований соцсети сообщают нам больше нового про сервис, чем про его пользователей. Например, Facebook умудрялась отслеживать и анализировать статусы, которые на самом деле никогда не «постились». Подозревали соцсеть и в давлении на электоральные предпочтения пользователей. Но самый противоречивый и удивительный факт о том, как сервис манипулирует аудиторией, стал достоянием общественности на прошлой неделе.

Первыми на него обратили внимание авторы The New Scientist и Animal New York: специалисты Facebook по сбору данных намеренно искажали отображение постов в лентах новостей (News Feed) 689 003 пользователей. На протяжении недели все невольные участники эксперимента видели в своих подписных потоках либо исключительно позитивные сообщения, либо, напротив, исключительно негативные. Facebook таким образом пыталась отследить психологическое воздействие эмоционально окрашенных постов на настроение пользователей.

Так что если с 11 по 18 января 2012 года вы видели в своих лентах сплошь фото мертвых собак или одни только изображения милых младенцев, знайте – вы могли быть частью эксперимента.

И хотя и на этот раз Facebook формально не нарушила никаких пунктов своей информационной политики, новость об эксперименте вызвала смешанную реакцию у аудитории.

Ожидаемый вывод, который сделала группа исследователей под руководством Адама Крамера, — настроение ленты Facebook влияет на настроение пользователя. «Когда мы снижали долю позитивных сообщений в ленте, люди и сами начинали реже писать позитивные посты и чаще — негативные, когда чистили ленту от негатива — наблюдалась обратная тенденция, — говорится в отчете соцсети об эксперименте. — Эти результаты свидетельствуют, что эмоции других пользователей Facebook влияют и на наши собственные эмоции. Мы получили экспериментальное подтверждение цепной эмоциональной реакции в социальных сетях».

За сухими формулировками скрывается спорный с моральной точки зрения и невероятный по масштабу опыт, в который оказались втянуты сотни тысяч людей по всему миру. Facebook сознательно корректировала их настроение в сторону приподнятого состояния духа или депрессии в зависимости от отображаемых в ленте постов, в диапазоне от галереи «15 фотографий, которые вернут вам веру в человечество» до статусов о потере работы или опоздании на авиарейс. «До суицида мы никого не довели», — позднее шутил в Twitter один из профессоров, проводивших исследование.

Авторы эксперимента напирают на практическую значимость своих выводов. Так, «цепная эмоциональная реакция» противоречит распространенному заблуждению о том, что наблюдение за жизнью более успешных друзей в социальной сети способно вызвать депрессию. Также ученые выяснили, что если зачищать ленту от эмоционально окрашенных постов, то человек становится «менее экспрессивным», к примеру, реже обновляет статусы (так что будьте готовы — если Facebook захочет сподвигнуть вас на более активное ведение профайла, ваша лента новостей может неожиданно наполниться самыми пронзительными постами друзей).

Насколько приемлемы подобные «игры разума», пусть даже в научных целях? Выводы исследования интересны, но манипулирование эмоциями — скользкая тропа, на которую ступила соцсеть. В политике в отношении обработки персональных данных говорится, что собранная информация может быть использована «для внутренних операций Facebook, включая устранение багов, анализ данных, тестирование новых опций, исследование и улучшение сервиса». Пользователи взамен получают разве что доступ к сокровенному знанию о существовании таинственных алгоритмов формирования Facebook ленты новостей. Для сравнения, эксперименты с участием людей, которые проводятся в университетах, всегда предварительно проходят согласование у профильного комитета по этике. Такая схема предотвращает негуманные методы исследований и сглаживает эффект от спорных опытов.

В Facebook же исследователи, в отличие от академических ученых, идут по максимально короткому пути от идеи до эксперимента над сотнями миллионов пользователей.

В комментарии по поводу исследования, присланном Forbes в ночь на 28 июня, пресс-служба социальной сети подчеркнула, что не разделяет беспокойства по поводу проведенного исследования. В компании пояснили, что акцент при проведении подобных опытов делается на обеспечении сохранности персональной информации, а не этических аспектах. «Это исследование проводилось на протяжении одной недели в 2012 году, никакие данные не соотносились с отдельными аккаунтами, — заявил представитель Facebook. — Мы преследовали цели улучшения качества сервисов и повышения релевантности отображаемого контента. Достичь этих целей без понимания того, как люди реагируют на различные типы материалов, невозможно. Мы прекрасно отдаем себе отчет в том, что за исследование проводим, и контролируем весь процесс внутри компании. Никакого незаконного сбора или некорректного использования личных данных не проводилось».